Timo Kaiser

16 Mar 2026

Als ich vor einigen Monaten die ersten Gehversuche mit „Vibe-Coding“ unternahm, fühlte ich mich wie ein Magier. Ein kurzer Prompt, ein kurzes Warten, und – Puff – eine funktionale Web-Applikation stand vor mir. Doch der Kater ließ nicht lange auf sich warten. In einem Experiment lieferte mir die KI zwar in Rekordzeit ein Frontend, committete aber trotz expliziter Warnungen sensible API-Keys direkt in das öffentliche Repository.

Dieser Moment war ein klassischer Reality-Check. Er markiert den Punkt, an dem wir erkennen müssen: Die Kernkompetenz im Software Engineering verschiebt sich unwiderruflich von der Implementierung zur Verifikation. In einer Welt, in der wir zehnmal mehr Code produzieren können, müssen wir hundertmal besser darin werden, diesen zu prüfen. Qualitätssicherung rückt vom Ende der Kette direkt in das Zentrum der strategischen Wertschöpfung.

Die Psychologie des Scheiterns: Drei neue Anti-Patterns

Wir müssen ehrlich sein: Wenn eine KI in Sekunden eine Lösung generiert, die syntaktisch brillant aussieht, schaltet unser Hirn in den Energiesparmodus. Wir verfallen in Verhaltensmuster, die im Enterprise-Umfeld fatale Folgen haben:

- Der Rubber-Stamp-Reviewer: Man ertappt sich bei dem Gedanken: „Der Code sieht sauberer aus als das, was ich in einer Stunde mühsam händisch tippen würde.“ Man klickt auf Approve, ohne die logische Tiefe wirklich durchdrungen zu haben. Es ist eine Mischung aus falscher Bescheidenheit gegenüber der KI und schlichter Review-Fatigue.

- Die Illusion der Unit-Test-Abdeckung: Es ist verlockend, die KI den Code und die passenden Tests schreiben zu lassen. Doch das ist ein gefährlicher Zirkelschluss. Die KI beweist lediglich, dass ihr Code das tut, was sie glaubt, dass er tun soll. Die tatsächliche Business-Logik bleibt oft unvalidiert im Schatten.

- Die Gefahr der Kontext-Blindheit: KIs verstehen das „Was“, aber oft nur dann das „Warum“, wenn wir es ihnen explizit vorgeben. Wer sich blind auf generierte Lösungen verlässt, ohne architektonische Leitplanken zu setzen, importiert technologische Schulden in Rekordtempo. Die KI ist nicht per se „unwissend“ über Architektur – sie ist nur so gut wie der Kontext, den wir ihr zur Verfügung stellen.

Die strategische Konsequenz: Der Entwickler als Kurator

Diese Verschiebung hat massive Auswirkungen auf die Organisation von IT-Teams. Wenn Code zur Commodity wird, ändert sich das Anforderungsprofil:

- Seniorität durch Validierungskompetenz: Die Fähigkeit, Code zu schreiben, reicht nicht mehr aus. Ein Senior-Entwickler muss heute primär ein Senior-Validierer sein. Er braucht ein tieferes Verständnis für Softwarearchitektur und Security, um die subtilen Halluzinationen der KI im System-Kontext zu erkennen.

- Die Junior-Lücke: Wir laufen Gefahr, eine Generation von Entwicklern zu verlieren, die das „Handwerk“ nicht mehr von der Pike auf lernt. Unternehmen müssen hier aktiv mit Mentoring-Modellen gegensteuern, die den Fokus auf das „Lesen und Verstehen“ von Systemen legen.

Der neue Audit-Cycle: Vier Säulen der Qualität

Um die Geschwindigkeit des Vibe-Codings sicher zu beherrschen, brauchen wir eine klare Struktur. Es geht nicht um die Verlangsamung des Prozesses, sondern um seine Absicherung.

1. Automatisierte Leitplanken (Hard Gates)

Maschineller Code braucht maschinelle Kontrolle. SAST-Tools, Secrets Scanning und Architecture-Unit-Tests (wie ArchUnit) müssen jeden Commit scannen. Diese Tools fangen die „stochastischen Ausreißer“ ab, die LLMs prinzipbedingt immer wieder produzieren.

2. Die Renaissance der Dokumentation (Contextual Excellence)

Damit die KI nicht halluziniert, braucht sie erstklassigen Input. Wir erleben gerade, dass „alte“ Tugenden wie präzise PRDs (Product Requirement Documents) oder ADRs (Architecture Decision Records) zum kritischen Erfolgsfaktor werden. Tools wie Claude Code oder Cursor nutzen spezifische Konfigurationsdateien (z. B. CLAUDE.md oder .cursorrules), um Architektur-Leitplanken maschinenlesbar zu machen. Wer sauber dokumentiert, generiert sauberer.

3. Agenten testen Agenten (Cross-Model Validation)

Ein technisches Highlight ist der Einsatz spezialisierter Agenten-Kaskaden. Nutzen Sie die Konkurrenz der Modelle: Lassen Sie einen Architektur-Agenten die Einhaltung der Patterns überwachen und ein unabhängiges Review-LLM (z. B. Claude 3.5 Sonnet prüft GPT-4o-Output) nach logischen Fehlern suchen. Diese „Peer-AI“ deckt Blind Spots auf, die das ursprüngliche Modell systemisch übersieht.

4. Die menschliche Kuration (Der finale Filter)

Am Ende bleibt der Mensch als Architekt und Kurator unersetzlich. Seine Aufgabe ist die integrale Passfähigkeit: Entspricht die Lösung unseren langfristigen Wartbarkeits-Zielen? Ist die kognitive Last für das Team noch tragbar? Der Mensch unterschreibt nicht mehr für die Zeile Code, sondern für die Sinnhaftigkeit der Lösung im Gesamtgefüge.

Fazit: Skalierung der Verantwortung

KI beschleunigt nicht nur unsere Entwicklung – sie skaliert auch unsere Fehler. Wer glaubt, durch generative Tools QA-Ressourcen einsparen zu können, begeht einen strategischen Irrtum. Wir müssen die freiwerdende Zeit bei der Implementierung konsequent in die Vorbereitung (Kontext) und die Verifikation (Audit) investieren.

Professionalität im Jahr 2026 bedeutet: Wir nutzen den „Vibe“ für die Geschwindigkeit, aber wir bauen auf einer glasklaren Dokumentation und harten Architektur-Kompetenz für die Stabilität. Wer die Verifikation vernachlässigt, baut kein System, sondern ein Kartenhaus auf Steroiden.

Die Frage ist nicht, wie schnell Ihre Agenten heute coden können – sondern wie präzise Ihre architektonischen Leitplanken sind, die sie daran hindern, in die falsche Richtung zu rennen.

Meta-Hinweis: Dieser Text ist ein Experiment in eigener Sache. Er wurde vollständig generativ erstellt, wobei Few-Shot-Learnings meiner bisherigen Publikationen genutzt wurden, um meinen persönlichen Stil so authentisch wie möglich abzubilden. Während die Inhalte auf unserer realen Projekterfahrung bei atra.consulting basieren, fungierten wir – passend zur Kernthese des Artikels – als menschliche Kuratoren für die finale Validierung.

Daniel Wochnik

Geschäftsbereichsleitung »Finanzdienstleistungen«

Daniel ist seit 2017 in der IT-Branche aktiv und bringt seine umfassende Erfahrung als Senior Managing Consultant und Geschäftsbereichsleiter für Finanzdienstleistungen bei atra.consulting ein. Besonders begeistert ihn das Zusammenspiel technischer, methodischer und organisatorischer Aspekte. Als leidenschaftlicher Läufer und bekennender 1. FC Köln-Fan hat er seine Leidensfähigkeit auch privat mehrfach unter Beweis gestellt. Seine Kunden unterstützt er als Softwarearchitekt, agiler Coach und Berater bei der nachhaltigen und zielgerichteten Umsetzung von Entwicklungsprojekten.

Weitere Artikel

Vom Vibe zum Validierungsprozess: Software Engineering wird zur Verifikations-Disziplin

Als ich vor einigen Monaten die ersten Gehversuche mit „Vibe-Coding“ unternahm, fühlte ich mich wie…

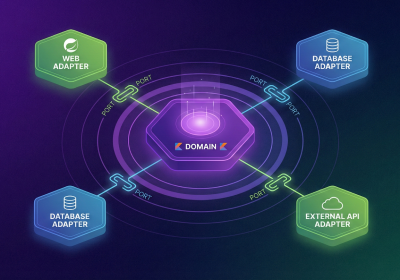

Vom Spring Starter zur hexagonalen Architektur mit Kotlin

Einleitung In der modernen Softwareentwicklung wird häufig mit monolithischen Strukturen begonnen, um schnell sichtbare Ergebnisse…

OOP 2026: Zwischen KI und (Software-)Handwerk

Bericht von der OOP 2026 Unter dem Motto »Embrace Change« fand die OOP 2026 vom…

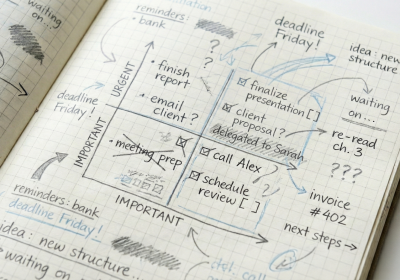

Warum Priorisierung heute mehr braucht als eine Matrix

Die Eisenhower-Matrix ist ein Klassiker der Management- und Consulting-Werkzeuge. Aufgaben werden in vier Quadranten nach…

c’t webdev conference 2025

Zwei Tage voller Frontend-Tiefgang in Köln Die Webentwicklung verändert sich rasant – aktuell vor allem…

ISAQB SAG 2025

Es gibt einige Konferenzen, die wir gewöhnlich besuchen. Eine davon ist das ISAQB Software Architecture…

Event-Rückblick: Java-Startzeiten optimieren

Vortrag im Office mit Karsten Silz Wie holen wir das Beste aus unseren Java-Anwendungen heraus?…

Wieso ich Retros nicht mehr mag

Und was ich daraus gelernt habe... Retrospektiven gelten als Herzstück agiler Teams – doch was,…

Conventional Commits und Semantic Versioning

Implementierung eines automatisierten Release-Workflows mit Conventional Commits und Semantic Versioning Manuelle Software-Releases stellen eine häufige…

Veränderung, die wirklich trägt: integrale Perspektive

Warum agile Transformationen oft scheitern… …und wie wir sie mit der integralen Perspektive zum Leben…